| 新闻 | 视频 | 博客 | 论坛 | 分类广告 | 购物 | 简体/繁体 | 广告服务 | 联系我们 | 关于万维 | 登录/注册 |

|

|

一台依靠光线而非传统计算机硬件生成图像的人工智能系统,可能让能耗骤减数百倍。

通常,AI从文字生成图像时会用到一种称为扩散的过程。模型先学习大量图片,并通过加入统计噪声来“破坏”它们,再把这些规律编码成一套规则。当系统得到一张新的带噪声的图像时,就能反向运算,逐步还原成与文字请求相符的清晰画面。

为了生成逼真、高分辨率的图像,这种扩散过程需要许多连续步骤,背后则是庞大的算力消耗。今年4月,OpenAI宣布其最新的图像生成器在上线的第一周就产出了超过7亿张图片。支撑这样的需求需要巨量的能源与水资源,用于机器运转和冷却。

Ozcan解释说:“与数字扩散模型需要成百上千次迭代不同,这个方法只需一次快照就能生成图像,除了最初的编码外不需要额外计算。”

具体做法是,团队先用公开的图像数据库训练数字编码器,让它能生成可转化为画面的“静态噪声”。接着,把这个编码与一种叫作空间光调制器的液晶屏结合,物理地将噪声印刻进激光束。当激光穿过第二块解码用的空间光调制器时,目标图像便瞬间浮现在屏幕上,再由相机捕捉。

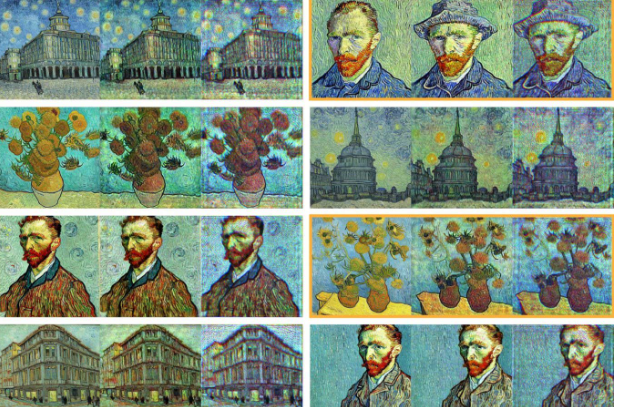

在实验中,这套系统成功生成了黑白数字图像(1到9)以及基础服装等常见测试对象,还创作出具有梵高风格的彩色画作。其效果与传统AI图像生成器相比,并无明显差别。

牛津大学的Alexander Lvovsky评价道:“这可能是第一个不再只是实验室玩具的光学神经网络,而是真正能产出有实际价值结果的计算工具。”

在能耗方面,差距尤为惊人。以梵高风格的彩色图像为例,这套系统每张图只消耗几毫焦耳的能量,大部分用于液晶屏,而传统扩散模型则需要数百到上千焦耳。Lvovsky形象地对比说:“后者相当于电热水壶一秒钟的耗电量,而光学机器的耗能只相当于百万分之一秒。”

未来若要替代现有的主流图像生成工具,这一系统还需进一步改造以适应数据中心。但Ozcan认为,它的低能耗特性更可能在可穿戴电子设备中找到用武之地,例如人工智能眼镜。

梵高原作与传统扩散模型(左)和光学图像发生器(右)

| 当前新闻共有0条评论 | 分享到: |

|

||||||||||

| 评论前需要先 登录 或者 注册 哦 |

||||||||||||

| 24小时新闻排行榜 | 更多>> |

| 1 | 习家“储君”出事?皇侄齐明正突然消失 |

| 2 | 北京七环大爆炸,传老习两口子躲了整整两天 |

| 3 | 习走错“关键一步” 渐失话语权 |

| 4 | 跨年夜,中国多个大城市现诡异一幕 |

| 5 | 大蒜是尿酸的杀手?想要肾脏健康这些蔬菜要 |

| 48小时新闻排行榜 | 更多>> |

| 一周博客排行 | 更多>> |

| 一周博文回复排行榜 | 更多>> |

| 1 | 台湾问题:麻将停牌 | 随意生活 |

| 2 | 川普到底卖了乌克兰没有? | 山蛟龙 |

| 3 | 梅兰芳和兩位仍然在世的入室弟 | 玉质 |

| 4 | 第一美女:《越人歌》-宋祖英 | YOLO宥乐 |

| 5 | 做这道题,知道明年你要去哪? | 末班车 |

| 6 | 关于离岸爱国 | 阿里克斯Y |

| 7 | 海外中文出版的新路基本开通, | 高伐林 |

| 8 | 70%美国大学毕业生找不到工作 | 乐维 |

| 9 | 大湾区的整合梦 | 文庙 |

| 10 | 给菓趣的回复,你至少有放风的 | renweida |